Wer hat es geschrieben - Mensch oder Maschine? Diese Frage wird man sich bei Artikeln zukünftig immer häufiger stellen. Inzwischen verfassen Algorithmen zehntausende Texte pro Tag. Der sogenannte Roboterjournalismus ist vor allem in den USA schon angekommen. Die Technik ist umstritten: Profitieren Journalisten von der Arbeitserleichterung oder stehen sie schon in wenigen Jahren auf der Straße? // Von Mika Baumeister

Die Zeit der Daten ist für viele Berufsgruppen eine Herausforderung. Das Stichwort Big Data sorgt bei Marketing-Experten und Chefs für großes Interesse, weil sich viele Daten ohne großen Aufwand automatisiert auswerten lassen. Gleichzeitig bedarf es weniger Personal zur Auswertung. Das gilt auch beim Journalismus.

Jede Information landet im Netz - seien es Börsenkurse, Entscheidungen der Politik, das Wetter oder Fußballergebnisse. Jene Daten lassen sich mit Algorithmen gezielt erfassen und Programme produzieren Texte, die sich laut Studien nicht von Menschen getippten Artikeln unterscheiden lassen. Das führt zur Entlastung von Redakteuren. So wird es zumindest von Anbietern passender Software dargestellt.

So entstehen computergenerierte Texte

Online gibt es inzwischen eine Vielzahl von Rohdaten, die für jedermann einsehbar sind. Riesige Tabellen werden sekündlich aktualisiert und von spezialisierten Programmen ausgelesen. Über Programmierschnittstellen (API, Application Programming Interface) lassen sich die Daten von jedem Computer mit Internetzugang analysieren und interpretieren.

Riesige Zahlentabellen – von Menschen kaum einzuordnen. Computer brauchen Millisekunden zur Interpretation. Foto: Mika Baumeister

Schon mit wenig Arbeit lässt sich ein einfaches Skript basteln, das die Daten in lesbaren Text umwandelt. Ein Beispiel macht das deutlich: Von einem Wetter-Portal lassen sich Informationen wie die Höchsttemperatur, die Regenwahrscheinlichkeit und die Zahl der Sonnenstunden auslesen. Mit diesen Informationen könnte automatisiert ein kurzer Artikel geschrieben werden:

"In Berlin scheint morgen für [Zahl der Sonnenstunden] Stunden die Sonne. Die Höchsttemperatur liegt bei [höchste Temperatur] Grad Celsius. Es wird mit einer Wahrscheinlichkeit von [Zahl zwischen 0 und 100] Prozent regnen."

Der Informationsgehalt reicht für eine einfache Information von Lesern oder Hörern aus. Tatsächlich nutzen Sprachassistenten wie Amazons "Alexa" oder Googles "Home" einen ähnlich einfachen Algorithmus.

Roboterjournalismus: Ein Erdbeben für die "LA Times"

Der erste computergenerierte Text wurde von der Tageszeitung "Los Angeles Times" veröffentlicht. Im März 2014 erschütterte ein kleines Erdbeben den amerikanischen Bundesstaat Kalifornien. Nur drei Minuten nach dem Ereignis hatte die LA Times den entsprechenden Artikel online. Ken Schwencke entwickelte das Programm, er taufte es auf den Namen "Quakebot"; zu Deutsch: "Erdbebenroboter".

Inzwischen arbeitet der Journalist bei dem spendenfinanzierten Investigativmedium "ProPublica". Er kann sich noch gut daran erinnern, wie das Programm damals entwickelt wurde (übersetzt aus dem Englischen): "Die Grundprinzipien hinter dem Erdbeben-Artikel waren schon lange in Gebrauch. Alles, was wir taten, war, die Textausgabe in etwas zu packen, das wie ein Zeitungsartikel aussah, anstatt es auf einer eigenen Seite (für reine Daten) zu publizieren."

Schwencke ist sich sicher, dass der automatisierte Journalismus mehr Jobs schafft. Als Beispiel nennt er die "Associated Press", kurz AP: "Die Nachrichtenagentur beschäftigt inzwischen einen 'News Automation Editor'. Die US-Medien müssen ständig Journalisten kündigen. Ich glaube allerdings nicht, dass jemand durch die Automatisierung seinen Arbeitsplatz verlor." Klar ist für ihn auch, dass es so bleiben wird. Journalismus sei seit jeher eine sehr menschliche Tätigkeit: Quellen anrufen, Unterlagen anfordern und Fragen stellen gehören fest dazu. „Ich war daher nie wirklich besorgt, dass Computer uns ersetzen werden."

Einer der größten Verwender von automatisiert erstellten News ist die von Schwencke erwähnte Nachrichtenagentur AP. Jedes Quartal veröffentlicht die Redaktion rund 4.400 Finanzberichte zu börsennotierten Unternehmen. Menschliche Mitarbeiter hatten lediglich eine Kapazität von rund 300 Berichten.

Zahlen werden zu Buchstaben

Textbeispiele für einen kompletten Spielbericht finden sich bei "Retresco", einer Firma, die sich auf das Verstehen, Verarbeiten und Generieren von Texten spezialisiert hat. Die Ähnlichkeit zu von Menschenhand geschriebenen Texten ist verblüffend:

Deutliche Pleite für Köln

Nach 90 Minuten im letzten Match der Saison verlor der 1. FC Köln 1:4 und verließ den Platz wie so oft in dieser Saison ohne Punkte. Das Hinspiel war eine knappe Angelegenheit gewesen, der Gast hatte sie letztendlich mit 1:0 für sich entschieden.

Noch fehlen nicht statistisch erhebbare Daten, etwa die Stimmung im Stadion. Trotzdem reicht der obige Text zur Einordnung aus. Die Zusatzinformation "wie so oft in dieser Saison" stellt eine Verknüpfung mit vergangenen Niederlagen der Kölner Mannschaft her.

"Wir helfen bei der Erstellung einfacher Texte"

Lydia Herrmann ist bei dem Software-Anbieter Retresco für das Content Marketing zuständig. Die Firma richtet sich unter anderem an Medienunternehmen und Online-Shops. Sie ist sich sicher, dass automatisierte Texte einen Mehrwert bieten: "Niemand möchte 100 Texte über Kleidungsstücke schreiben!". Die Programme aus dem Portfolio des Unternehmens können automatisch Themen erkennen, strukturieren und dem Leser vorschlagen. Ein Semantik-Tool erkennt Schlagwörter und verlinkt automatisch auf Artikel, die für den Beitrag im jeweiligen Kontext sinnvoll sind.

Das ist der Roboterjournalist der Zukunft – vielleicht. Foto: Franck V., Unsplash

Um Beiträge automatisch zu generieren, benötigen Unternehmen inzwischen keinen Programmierer mehr. Herrmann vergleicht das Tool mit einem Baukasten. "Ist das Programm einmal mit lesbaren Daten gefüttert, sucht es sich passende Formulierungen im jeweiligen Zusammenhang heraus", erklärt sie. Um zum Fußball-Beispiel zurückzukehren: Hätte der FC Köln 1:0 gewonnen, würde es "Köln entgeht dem Abstieg knapp" heißen.

Ein Computer generierte die Fußballanalyse. In Fachkreisen fällt diese Technik unter die Kategorie "Natural Language Generation" (NLG). Zusätzlich ist die Firma auch in der Lage, Texte für Programme lesbar zu machen. Diese Methode hört auf den Fachbegriff "Natural Language Understanding" (NLU) und wird dazu genutzt, Texte besser zu strukturieren und zum Beispiel für Leser interessante Links zu ähnlichen Beiträgen automatisiert anzuzeigen. Sowohl NLG als auch NLU gehören zur Hauptgruppe des "Natural Language Processings" (NLP): Unter diesem Begriff sammeln sich alle Technologien, die mit der Verarbeitung von Sprache zu tun haben.

Zu den Kunden gehört unter anderem die Commerzbank, die einen internen Chat-Bot mit der NLU-Technologie aufbaute. Mitarbeiter können dem Tool Fragen stellen, Antworten gibt es in Sekundenbruchteilen. Zahlreiche weitere Kunden nutzen das Software-Portfolio von Retresco zur Kategorisierung von Nachrichten, Semantik-Analyse oder der bereits genannten Textgenerierung.

Bücher - geschrieben mit Nullen und Einsen

Neben kurzen News-Artikeln können Computer inzwischen sogar ganze Romane kreieren. Fans der Romanreihe Harry Potter fütterten sieben Bücher in ein Programm, das anschließend ein dreiseitiges Kapitel schrieb. Auch den Titel hat die Software selbst gewählt.

We used predictive keyboards trained on all seven books to ghostwrite this spellbinding new Harry Potter chapter https://t.co/UaC6rMlqTy pic.twitter.com/VyxZwMYVVy

— Botnik Studios (@botnikstudios) December 12, 2017

"Harry Potter und das Portrait, das nach einem großen Haufen Asche aussah" wurde allerdings nie zu einem Erfolg. Dafür war die Qualität des Textes noch zu schlecht. Trotzdem ergab das geschriebene Wort zum Teil Sinn - auch wenn Ron mit Sicherheit nie Hermines Eltern verspeisen wollte.

Künstlich generierte Bücher zeigen, wohin der Weg führt: Künftig müssen keine klare Daten in Zahlenform mehr vorliegen. Roboterjournalisten können sich an normalen, bereits geschriebenen Texten ohne empirische Anhaltspunkte orientieren und Sachverhalte wie in einer riesigen Mindmap miteinander verbinden.

Bis die Beiträge aus Maschinenhand allerdings so gut werden wie in Marc-Uwe Klings Buch "QualityLand" beschrieben, in dem menschliche Autoren durch Roboter ersetzt wurden, wird es wohl noch eine Weile dauern.

Die Qualität stimmt - zumindest bei News

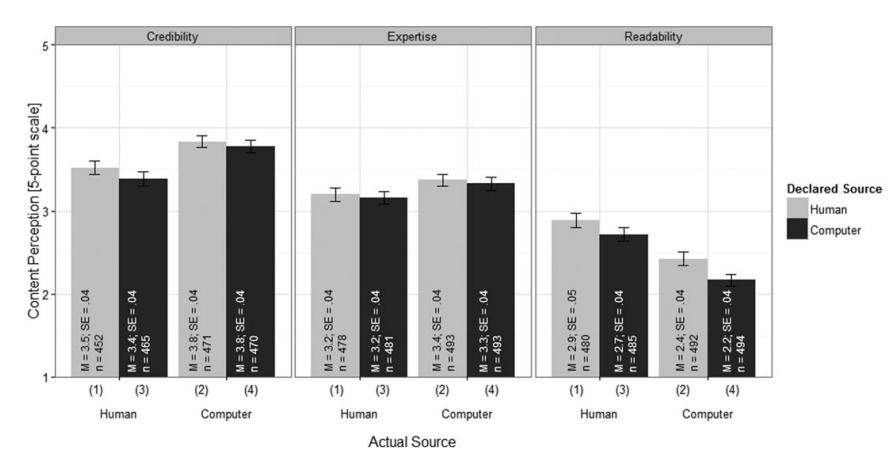

Lesenswerte Bücher aus Computerhand sind noch Zukunftsmusik. Aber kurze Texte, die Fakten zusammenfassen, sind echten Artikeln zum Verwechseln ähnlich. Zum Teil werden sie sogar besser bewertet als von Menschen geschriebene Texte. Das beweist eine Studie der Ludwig-Maximilians-Universität München und des Fraunhofer Instituts für Kommunikation, Informationsverarbeitung und Ergonomie (FKIE) aus dem Jahr 2016: Vier Forscher befragten 986 Personen zum Thema Roboterjournalismus. Sie wollten herausfinden, ob ihnen der Text eines echten Menschen oder einer Maschine besser gefällt.

Diese Statistik zeigt: Computer schreiben glaubhafter und mit mehr Kompetenz als Menschen. Quelle: Studie "Reader's perception of computer-generated news, credibility, expertise, and readability"

Den Probanden wurden jeweils Artikel aus den Gebieten Sport und Finanzen gezeigt, die Texte wurden von Menschen und Maschinen geschrieben. Anschließend wurden Glaubhaftigkeit, Expertise und Lesbarkeit auf einer Skala bis fünf bewertet. Je höher die Werte, desto besser schnitten die Texte ab. Die Ergebnisse: Grundsätzlich wird menschlichen Journalisten eine größere Glaubhaftigkeit, Expertise und Lesbarkeit zugerechnet - egal, ob die Neuigkeit wirklich von Menschen oder doch von einem Computer stammt.

Gleichzeitig schnitten automatisch generierte Texte in den beiden Kategorien Glaubhaftigkeit und Expertise besser ab als die von Journalisten getippten News. Die Teilnehmer bewerteten lediglich die Lesbarkeit bei Maschinentexten schlechter. Menschen können derzeit "schöner" formulieren als künstliche Intelligenzen.

"Roboter können nicht einordnen"

Kritisch sieht die Entwicklung der Deutsche Journalisten-Verband (DJV). Pressesprecher Hendrik Zörner berichtet, dass der Roboterjournalismus nur in Ansätzen in Deutschland angekommen sei. Die digitale Entwicklung sei auch beim Journalismus in vollem Gange. "Deswegen ist es gut und wichtig, dass über die Rolle des Roboterjournalismus gesprochen wird", erklärt Zörner.

Der Pressesprecher des DJV zeigt sich bei Zukunftsprognosen zurückhaltend. In 10 oder 20 Jahren könnte sich das Gesamtbild komplett verändert haben. Trotzdem scheint sich Zörner recht sicher, welche Absicht hinter der Einführung von Textprogrammen in Medienhäusern steckt: "Die Programme sollen natürlich nicht nur Redaktionen erleichtern, sondern auch Kosten sparen". Die Anschaffungskosten von automatischen Skripten sind recht hoch, amortisieren sich aber nach kurzer Zeit. Schließlich müssten keine Journalisten oder Freiberufler mehr bezahlt werden, um einfache Beiträge zu schreiben.

Computer sind noch nicht in der Lage, den großen Kontext zu "realisieren". Foto: Thomas Kvistholt, Unsplash.com

Ob der Roboterjournalismus ethisch vertretbar ist? "Muss man sehen", antwortet er skeptisch. Noch hielten sich Verbreitung und Intelligenz der angebotenen Algorithmen in Grenzen. Aber: Der Stellenwert steigt stetig. Die Programme lassen sich einfacher benutzen, im Netz gäbe es mehr und mehr auslesbare Datensätze und auch die Kostenersparnis sei nicht von der Hand zu weisen.

Menschliche Journalisten bleiben in den nächsten Jahren und Jahrzehnten fester Bestandteil der Medienwelt: "Roboter können nicht bewerten, nicht einschätzen und nicht einordnen", so Zörner. Menschen müssen weiterhin versteckte Sachverhalte erkennen und diese gut erklärt aufbereiten. Beim "Tabellenjournalismus" oder Sportberichten sei dies nicht so wichtig, komplexe wirtschaftliche Zusammenhänge blieben den Programmen bisher aber meist verborgen.

Journalismus lässt sich schwer komplett automatisieren

Bisher sind die Grenzen von Roboterjournalismus recht klar gesteckt. Das, was den Journalismus ausmacht, fehlt: Warum ist etwas passiert? In welchem Kontext muss die Neuigkeit betrachtet werden? Wo lässt sich die Meldung einordnen? Noch fehlen Datensätze, die Korrelationen so detailliert erfassen. Firmen wie Google arbeiten mit Hochdruck an Programmen, die auch Zusammenhänge ohne riesige Datenbanken erkennen können. Aber selbst dann wäre die Software nicht in der Lage, investigative Recherchen durchzuführen.

Aus diesen Gründen ist der Beruf des Journalisten einer der am wenigsten durch die Automatisierung bedrohten Jobs überhaupt. Die BBC bietet ein interaktives Tool an, in dem die Wahrscheinlichkeit der Automatisierung von mehr als 350 Berufsgruppen verglichen wird (Stand 2015). Die Wahrscheinlichkeit, dass Journalisten durch Computer ersetzt werden, liegt bei lediglich acht Prozent. Telefonisten sind in einigen Jahren mit fast einhundertprozentiger Wahrscheinlichkeit obsolet. Guter, echter Journalismus ist unabdingbar - nicht zuletzt wegen Themen wie den Panama Papers und der NSA-Affäre. Ken Schwencke sieht es besonders finster: "Wenn Maschinen eines Tages einen Bürgermeister stürzen können – nun ja, dann werden sie wahrscheinlich auch schlau genug sein, um uns sowieso auszulöschen."

Teaserbild: Foto: Bob Newman, Unsplash.com

Der Autor:

Mika Baumeister